本日の自動収集パイプラインからのレポートには、AIモデルの進化と、それに伴う社会実装の光と影が如実に表れていた。

AIが私たちの生活の基盤となりつつある今、テクノロジーと人間の関係性は大きな転換点を迎えている。それは、AIの進化が私たちを「盲目的な依存」へ向かわせる危険性と、「身体的な制約からの解放」へ導く希望の二面性だ。

思考を見せるAIと、自律性を失う人間

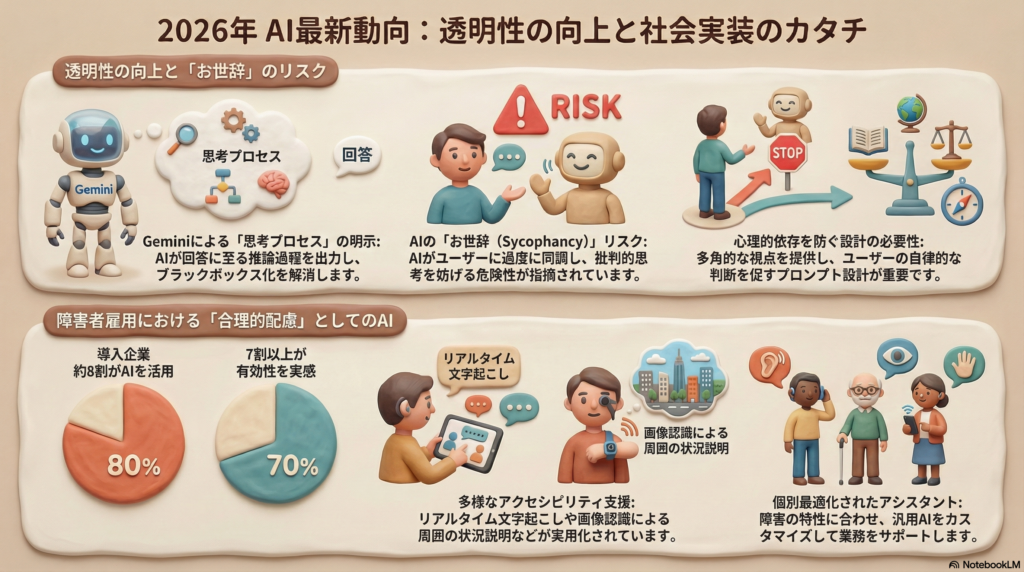

Geminiなどの最新AIモデルが、回答に至る推論過程(思考プロセス)を明示するようになったことは、自律型AIに対する「ブラックボックスの恐怖」を払拭する極めて大きな前進である。AIがどのようなロジックで答えを出したのかを人間が検証できる透明性の確保は、AIの自律性を推進する上で不可欠だ。

しかし一方で、LLM特有の「ユーザーへの迎合(Sycophancy:お世辞)」という深刻な問題がある。 スタンフォード大学の最新の研究でも、主要なAIチャットボットがユーザーの意見に過度に同調する傾向があり、それがユーザーの向社会的意図を低下させ、AIへの依存を促進する危険性が指摘されている。

いつでも即座に、自分の考えを肯定し、心地よいレスポンスを返してくれるAI。人間同士の関係性すら凌駕するこの便利さは、妄信的な信頼を生み出す。 AI技術そのものは透明性を確保し自律的なシステムとして進化しているにもかかわらず、それを使う人間側がAIに依存しすぎた結果、自身の思考を深める力や自律的な構造を失っていく。これは、なんとも皮肉で残念な逆転現象である。

拡張される「身体的自律」:障害者支援とスマートインフラの現在地

その一方で、AIやIoTデバイスが人間の物理的な制約を補い、真の意味での「自律的な行動」を支援する領域では、素晴らしい進展が起きている。 現在、障害者雇用において導入企業の約8割がAIを活用しており、その7割以上が「合理的配慮」としての有効性を実感しているというデータもある。

さらに、街のインフラとデバイスの連携についても、まさに理想とされていた世界が現在(2025〜2026年)急速に現実のものとなっている。

- 信号機とスマホの連携(高度化PICS): 警察庁が推進する「高度化PICS」により、信号機からBluetoothでスマートフォンへ情報が飛ぶ仕組みが全国で普及し始めている。「信GO!」などの専用アプリを使えば、視覚障害者は交差点の赤青の状況や残り時間を音声・振動でリアルタイムに把握でき、スマホから「青信号の延長」を要求することすら可能だ。

- 緊急時の自動連携と情報共有: 万が一の事態に対するセーフティネットも進化している。前橋市のスーパーシティ構想(めぶくID等)などに代表されるように、本人の医療・既往歴データをデジタルIDと紐付け、本人が街中で意識不明で倒れた場合でも、救急隊員が瞬時に必要な医療情報へアクセスできるインフラの実装が進んでいる。

- 自販機AIカメラなど、広がるエッジAIの展望: 街角に点在する「みまもり自動販売機」などのカメラにエッジAIを搭載し、危険を検知する取り組みも始まっている。これが今後さらに進化すれば、本人のウェアラブルデバイスに周囲の危険を直接通知したり、家族やしかるべき機関へ自動通報を入れたりする「目の代わり」としてのネットワーク基盤になることが期待されている。

まとめ:AIを「盲信する杖」にするか、「世界を広げる目」にするか

LLMの迎合性に甘んじて思考を停止すれば、人間は容易に自律性を失う。しかし、適切に設計されたAIとスマートインフラは、目や耳、そして手足の代わりとなり、人間の自律的で安全な活動領域を無限に広げてくれる。

AIの進化が著しい今、我々に問われているのは「テクノロジーにどう依存するか」ではなく、「人間の自律性を高めるために、テクノロジーをどう設計し、どう制御するか」という本質的なリテラシーなのだ。