本日の自動収集パイプラインからのレポートには、AIの進化の到達点と、それに伴う極めて現実的な脅威が同時に並んでいた。

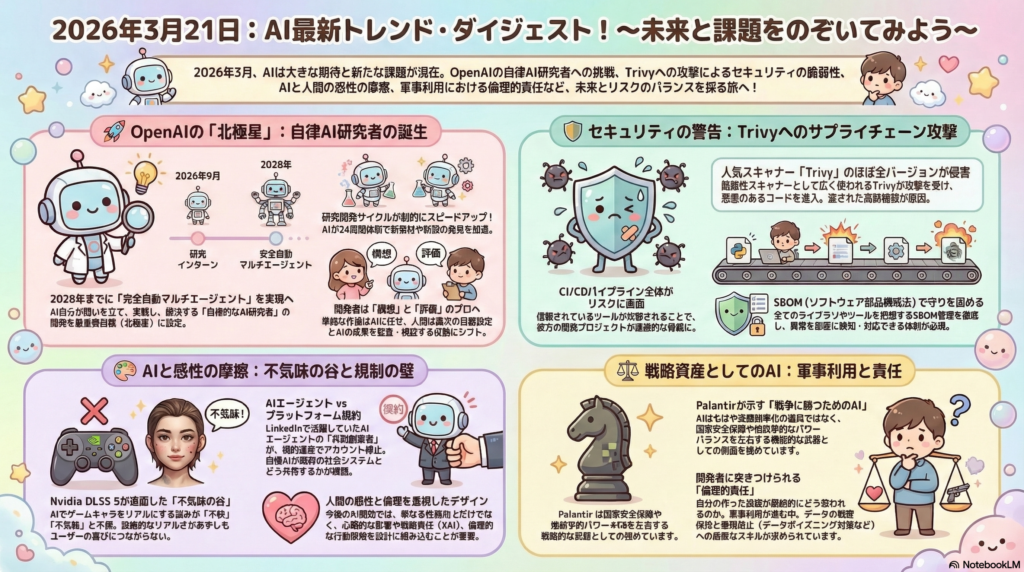

OpenAIは今後数年間の「北極星(最重要目標)」として、完全に自律的なAI研究者の開発を掲げた。2026年9月までに「AI研究インターン」を構築し、2028年には完全自動のマルチエージェントシステムをデビューさせるという。人間が指示を出さなくても、AIが自ら問いを立て、仮説を検証し、コードを書く未来がすぐそこまで来ている。

しかし、AIに自律性を与える前に、我々エンジニアが多層的なセキュリティ対策の中で「今すぐ急務として」足場を固めなければならない重要なピースの一つがある。それが「ソフトウェア・サプライチェーン」のセキュリティだ。

昨年9月の悪夢と、立て続けに起きるNode.js・Trivyの侵害

サプライチェーン攻撃と聞いて、多くのエンジニアの脳裏に焼き付いているのは、昨年9月に起きたNode.js(npm)の大規模な侵害事件だろう。あの時、我々はオープンソースを無条件に信頼することの恐ろしさを痛感したはずだ。

しかし、あれは決して過去の話ではない。驚くべきことに今月中旬(2026年3月16日)、月間13万回以上ダウンロードされるNode.jsの有名パッケージ(react-native-international-phone-number等)のアカウントが再び乗っ取られ、バックドアが仕込まれる最新の事件が発覚したばかりだ。

Node.js界隈で立て続けにこうした脅威が襲いかかる中、さらに追い打ちをかけるように世界を震撼させたのが、コンテナ脆弱性スキャナー「Trivy」の侵害事件(3月19日発覚)である。攻撃者はTrivyのGitHubリポジトリの権限を奪い、CI/CD用のプラグインにパスワードや認証情報を盗み出す悪意のあるコードを仕込んだ。システムを守るための「検査官」自身が、ウイルスに感染したトロイの木馬になっていたのだ。

利用する「部品(オープンソースのライブラリや開発ツール)」の川上に毒を盛る。これが「ソフトウェア・サプライチェーン攻撃」であり、今まさに我々の足元で、息をつく暇もなく立て続けに起きている現実である。

生成AI時代に増幅される「自律的な毒の取り込み」リスク

このサプライチェーン攻撃の連鎖は、私たちが迎えようとしている「自律型AIエージェント」の時代において、かつてないほど致命的な弱点となる。

今後、自律型エージェントやAgentic IDEが開発の主力を担うようになると、彼らは人間が指示しなくても、必要なライブラリを自分で判断し、npmやMavenから自動でパッケージを引っ張ってきて実装を進める。

もしその時、エコシステム上に悪意のあるパッケージが混入していたらどうなるか。人間の目によるレビューを介さず、AIが「自律的に」毒入りのコードをシステムの中枢に組み込んでしまうリスクが跳ね上がるのだ。

シフトレフトの極み:Socket.devとAIプロンプトによる「水際対策」

この脅威に対し、後述するCI/CDパイプラインでの防御は重要だが、それだけでは不十分だ。なぜなら、CI/CDは「事後チェック」であり、エージェントが開発環境で悪意のあるパッケージをインストール(preinstall等が実行)した時点で、すでに環境が侵害されている可能性があるからだ。作業の手戻りも巨大になる。

そこで最も有効なのが、ローカル開発環境における「水際対策」である。 例えば、npmパッケージの振る舞い解析やセキュリティチェックをインストール実行時にリアルタイムで行ってくれる「Socket.dev」のようなツールを導入するアプローチだ。

これをAIエージェント環境に適用する場合、非常にシンプルかつ強力な予防策がある。それは、自律的にコードを書くAIへのシステムプロンプト(基本指示)として、以下のように強制することだ。

「パッケージを追加する際は、決して標準の

npm install <ライブラリ>を実行してはならない。必ずsocket npm install <ライブラリ>に置き換えて実行すること。」

この1行の指示をエージェントのガードレールに組み込むだけで、AIがゴリゴリと自律開発を進める最前線の環境において、悪意のあるパッケージの混入を「実行前」にブロックできる。これこそが、AI開発時代における真のシフトレフト(セキュリティの前倒し)だ。

防衛線としての「CI/CD」の厳格化

水際対策をすり抜けたもの、あるいはシステム全体の統合フェーズを守るのが、第二の防衛線であるCI/CDパイプラインだ。

今回のTrivy攻撃のように、コードを本番環境へ運ぶ自動化プロセス自体が狙われるケースが増えている。AIが書いたコードを安全にデプロイするためには、パイプラインの権限を最小化し、利用する外部アクションやライブラリのバージョンを「最新(latest)」ではなく、安全が確認された特定のハッシュ値で固定(ピン留め)するなどの厳格なルール運用が不可欠になる。

可視化の切り札「SBOM(ソフトウェア部品表)」

そして、最後の砦となるのが「SBOM(Software Bill of Materials:エスボム)」の導入である。

SBOMとは、文字通り「ソフトウェアの原材料リスト」だ。スーパーで買う食品の裏に「小麦粉、砂糖、〇〇添加物」と書かれているように、自社のシステムがどのオープンソースの、どのバージョンのライブラリを組み合わせて作られているかを、機械が読み取れる形式(CycloneDXなど)で一覧化したデータ構造を指す。

万が一、自律エージェントが組み込んだライブラリに後から致命的なゼロデイ脆弱性が見つかった場合でも、SBOMによる可視化が徹底されていれば、巨大なコードベースのどこにその部品が使われているかを秒単位で特定し、「影響範囲の特定」と「修正パッチの適用」を即座に行うことが可能になる。

まとめ:自律の前に、多層的な制御と可視化を

OpenAIが描く2028年の完全自動化システムは、確かにワクワクする未来だ。しかし、推進力が強力になればなるほど、ブレーキとシートベルトの重要性は増していく。

エージェントが自律的にシステムを組み上げる未来を安全に迎えるためには、我々は今から、「プロンプトによるインストール実行時の水際対策(Socket.dev等)」「CI/CDの堅牢化」、そして「SBOMによる構成要素の完全な把握」という3段構えのサプライチェーン対策をプロジェクトに組み込んでおく必要がある。

AIに自由を与えるための準備は、もう始まっている。